Analyse technique de DVDFab NVIDIA AI Enhancer basé sur RTX Video HDR

Table des matières

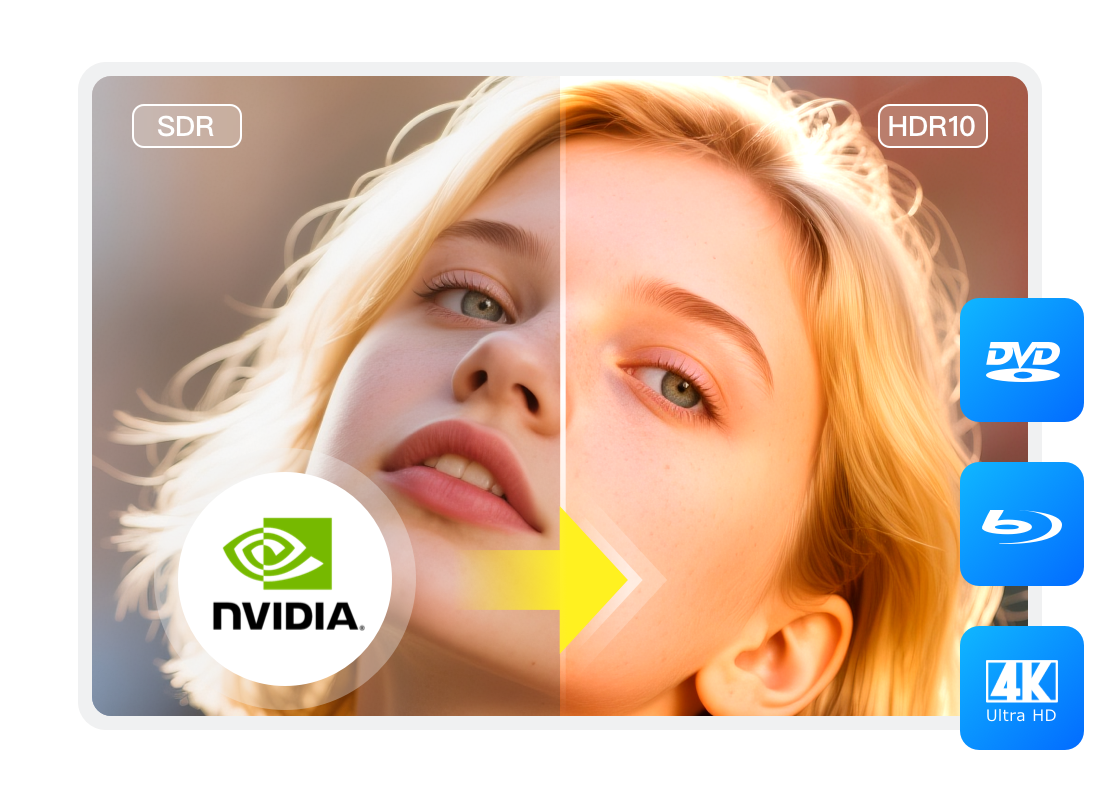

Introduction : Remettre en question les perceptions grand public de l’IA HDR

Malgré les avancées rapides du traitement vidéo par IA, les idées fausses concernant la conversion SDR-vers-HDR en temps réel restent largement répandues. Bien au-delà de simples filtres de luminosité/contraste, les pipelines NVIDIA RTX Video HDR exploitent une inférence tensorielle sophistiquée pour reconstruire la plage dynamique et la fidélité des couleurs, pouvant — parfois — surpasser les encodages HDR natifs. Cet article remet en cause les perceptions « superficielles » de l’IA HDR, en examinant ce qui différencie réellement les solutions de nouvelle génération de leurs prédécesseurs.

🌨️ Remarque : les principes techniques de NVIDIA RTX HDR font référence à l’utilisation des Tensor Cores des GPU RTX pour exécuter une analyse vidéo image par image pilotée par IA, aboutissant à un remappage HDR10 dynamique qui reconstruit la couleur et le contraste bien au-delà d’un simple tone-mapping.

RTX Video HDR : Fondements techniques & théorie de fonctionnement

Établir la base : HDR vs SDR — Gamut, luminosité et plage dynamique

HDR10 vs SDR : HDR10 prend en charge un espace colorimétrique plus large (Rec.2020 vs. Rec.709), une plage dynamique plus élevée (jusqu’à 1000 nits) et une profondeur de 10 bits par canal, permettant des détails visuels plus riches et des dégradés plus fluides par rapport au SDR.

L’écart technique entre SDR et HDR10 est considérable : alors que le SDR (Standard Dynamic Range) repose généralement sur l’espace colorimétrique Rec.709, 8 bits par canal, et une luminosité maximale inférieure à 300 nits, le HDR10 exploite Rec.2020, une quantification sur 10 bits et jusqu’à 1000 nits ou plus. Cette différence n’est pas « triviale » ; elle constitue le défi fondamental que tout pipeline basé sur l’IA doit relever pour produire une sortie qui corresponde visuellement — et structurellement — aux masters HDR professionnels ou UHD Blu-ray natifs.

Comment les Tensor Cores permettent l’inférence IA en temps réel

Contrairement aux filtres vidéo conventionnels exécutés par CPU, les pipelines NVIDIA RTX exploitent des Tensor Cores dédiés pour l’inférence IA parallèle. Chaque image est répartie sur des dizaines (ou centaines) de ces accélérateurs, optimisés pour les opérations matricielles en précision mixte au cœur des réseaux neuronaux convolutifs (CNN). Concrètement, cela signifie une exécution en temps réel — les analyses et le remappage des pixels sont terminés à la vitesse de lecture, même en UHD/4K ou 8K.

Tone-mapping et amélioration adaptés à la scène

Plutôt que d’appliquer des courbes statiques, RTX Video HDR utilise une amélioration contextuelle image par image : un réseau neuronal évalue non seulement la luminosité moyenne mais aussi le contraste local, les variations de mouvement et « l’intention de la scène » en analysant le flux optique et les histogrammes de couleurs. Cela permet de préserver les détails dans les ombres, de récupérer les tons moyens et de supprimer les artefacts — tâches où les anciens upscalers ou conversions basées sur LUT échouent généralement.

Logique d’optimisation de la luminosité et des couleurs

Le modèle IA est ajusté pour reconnaître et reconstruire les hautes lumières étendues sans « écrêtage », pousser les couleurs saturées vers les cibles Rec.2020 et réduire le banding grâce à un dithering intelligent et une gestion de la profondeur de bits. Il s’agit moins d’effets « tape-à-l’œil » que de conformité technique et de subtilité visuelle.

Parallélisme & pipeline temps réel

Comme pour les charges vidéo classiques, les performances réelles reposent sur l’équilibrage des charges : combinaison de la bande passante mémoire GPU, de la disponibilité des Tensor Cores et de l’orchestration au niveau des pilotes. Une optimisation pratique — telle que le traitement par lot, la réduction des transferts mémoire et l’ajustement de la granularité de l’inférence pour les coupures de scène ou les mouvements rapides — différencie les pipelines qui peinent à suivre de ceux qui permettent un véritable rendu en qualité de lecture.

| Spécification | HDR10 | SDR |

| Espace colorimétrique | Rec.2020 | Rec.709 |

| Profondeur de bits | 10 bits/canal | 8 bits/canal |

| Luminosité max | Jusqu’à 1000 nits (parfois plus) | ~300 nits |

| Plage dynamique | Large (vrai noir à haut nit) | Limitée |

| Support format | HEVC/AVC, UHD Blu-ray | H.264/AVC, Blu-ray/DVD |

| Métadonnées | Rarement utilisées | Statique/dynamique prises en charge (HDR10) |

👉 Points clés :

- La vidéo HDR ne se définit pas uniquement par des hautes lumières plus « brillantes », mais par un mapping supérieur des couleurs, des dégradés et du contraste.

- Les Tensor Cores sont le cœur qui permet l’amélioration en temps réel — évolutif même sur des GPU RTX d’entrée de gamme grâce au parallélisme.

- La logique IA réellement adaptée à la scène va bien au-delà d’un simple upscaling basique.

DVDFab NVIDIA AI Enhancer : Pipeline de traitement complet

Une conversion SDR-vers-HDR efficace et de haute fidélité repose sur bien plus que la puissance brute du GPU ou la « profondeur » d’un modèle IA. La véritable efficacité du flux de travail exige un pipeline intégré étape par étape — chaque étape conçue pour maximiser la qualité tout en minimisant l’intervention manuelle, les réglages utilisateur ou les artefacts indésirables. DVDFab NVIDIA AI Enhancer offre l’un des exemples les plus robustes d’IA HDR pratique et réelle, avec un accent clair sur la compatibilité et l’automatisation.

Analyse et prétraitement d’entrée

Le pipeline commence par une analyse approfondie de l’entrée, vérifiant l’intégrité du flux vidéo, le framerate, la résolution et le format (ex. Blu-ray MKV, MP4 ou anciens DVD VOB). Le prétraitement vérifie également les drapeaux d’espace colorimétrique et les métadonnées intégrées, car l’identification correcte du SDR Rec.709/601 ou des valeurs YUV est essentielle à la précision de l’analyse en aval.

Reconnaissance du format & des métadonnées

Des routines automatisées extraient les détails du conteneur (codec AVC/HEVC, par ex.), les flux audio, les timecodes, le chapitrage et les points de coupe définis par l’utilisateur. Cette phase garantit qu’aucun élément ne « casse » lors du transfert du prétraitement à l’amélioration IA, et que la sortie HDR est balisée en pleine conformité avec les exigences de métadonnées des appareils/écrans.

Méthodes de réduction de bruit & de normalisation des couleurs

Contrairement aux étapes classiques « d’amélioration vidéo », la réduction de bruit et la normalisation des couleurs sont assurées par des algorithmes spatio-temporels avancés adaptés au contenu SDR. Objectif principal : supprimer le bruit en moustiques, les artefacts de compression et les déséquilibres de balance des blancs — sans aplatir la plage dynamique ni perdre l’intention originale.

Traitement IA de la luminance, des couleurs et des détails

Le cœur de l’enhancer est un modèle IA conçu pour remapper sélectivement la luminance, restaurer le contraste local et récupérer les dégradés de couleurs perdus lors du codage SDR. En exploitant les Tensor Cores du GPU, des centaines d’images peuvent être traitées et comparées simultanément — permettant au réseau d’apprendre la structure de la scène et d’appliquer des courbes de tons adaptatives, plutôt que des LUT fixes ou de simples interpolations. Fait important : aucune surexposition excessive ni halo anormal n’est introduit, car la conformité de sortie est mesurée par rapport aux cibles techniques HDR10.

Calcul parallèle accéléré par GPU

La latence et le débit sont déterminés par l’équilibrage des charges : maximiser l’occupation des Tensor Cores, ajuster la taille des lots et optimiser les transferts de données entre VRAM et RAM. L’implémentation de DVDFab minimise les pics de ressources système et peut évoluer à partir des GPU RTX série 20 de milieu de gamme — un facteur clé pour les utilisateurs disposant de matériel moins puissant.

Cartographie dynamique au niveau des scènes

Les scènes et même les sous-scènes sont analysées indépendamment en fonction du contenu en mouvement, de la répartition ombre/haute lumière et des accents de couleur. Cela permet un ajustement par plan ou par scène qui conserve le « naturel » — contrairement aux filtres statiques globaux qui ignorent la diversité intra-image.

Cartographie HDR finale : synthèse & sortie

Une fois l’inférence IA terminée, les images HDR mappées en tons sont synthétisées en une piste vidéo continue, respectant la fréquence d’images originale, le ratio d’aspect et, le cas échéant, les chapitres. La sortie est ensuite empaquetée avec des métadonnées HDR10 mises à jour, une synchronisation AV maintenue et une prise en charge complète de la spécification conteneur UHD.

Sorties : HEVC/H.265, HDR10

L’encodage prend en charge HEVC/H.265 complet et HDR10 le cas échéant. Le pipeline est optimisé pour minimiser les artefacts de ré-encodage, fournir une navigation chapitre exacte et maintenir un passthrough audio complet (ex. Dolby Atmos).

Optimisation système & allocation des ressources

L’enhancer surveille en continu la charge système, allouant dynamiquement les cœurs et la VRAM en fonction de la profondeur de la file d’attente et de la complexité de la tâche. Sur les plateformes multi-GPU, une logique de découpage et de synchronisation des lots est disponible, garantissant un débit optimal que ce soit pour des fichiers uniques ou des traitements par lots.

Points clés

- Les flux de travail automatisés entraînent une intervention manuelle minimale.

- L’ajustement IA au niveau de la scène produit un HDR plus « réaliste » que les filtres statiques globaux.

- La plateforme est évolutive — les GPU RTX d’entrée de gamme suffisent pour des tâches par lots non temps réel.

HDR10 vs SDR : implications techniques & visuelles

L’amélioration vidéo moderne exige une conscience aiguë à la fois des écarts techniques objectifs et de l’impact visuel subjectif distinguant le SDR du HDR10. Alors que beaucoup de marketing glossent ces distinctions, les enjeux sont réels : la conversion doit respecter les standards de conformité et offrir une expérience utilisateur perceptiblement améliorée.

Expansion des espaces colorimétriques : Rec.709 vers Rec.2020

HDR10 vs SDR espace colorimétrique : le SDR utilise Rec.709 (~35% des couleurs visibles), tandis que HDR10 exploite Rec.2020, capturant jusqu’à 75% — permettant des images plus riches, plus vibrantes, avec des dégradés plus subtils et moins de banding.

Références luminosité/contraste

HDR10 augmente les niveaux de blanc de pointe à 1000 nits (souvent plus) contre ~300 nits pour le SDR. Il améliore aussi la profondeur des noirs — cruciale pour les contenus riches en ombres. Dans les benchmarks, un HDR10 bien masterisé permet jusqu’à 3x plus de plage dynamique visible. On le perçoit par l’éclat des reflets, les détails dans les nuages ou la subtilité des textures proches du noir — effets impossibles à reproduire par un simple filtre SDR→HDR.

Restauration des détails dans les scénarios réels

Avec le mapping avancé par IA, l’amélioration SDR-vers-HDR peut restaurer des détails d’ombres ou de hautes lumières « perdus » en raison des limites d’encodage SDR. Le modèle neuronal utilise des indices contextuels (ex. historique des images, relations chromatiques) pour reconstruire des détails plausibles — produisant parfois des résultats subjectivement meilleurs que certains HDR natifs mal encodés.

Vitesse et praticité des processus NVIDIA RTX HDR

Quelle est la praticité de l’amélioration vidéo SDR-vers-HDR par IA pour les professionnels et passionnés ? Alors que les démonstrations industrielles mettent souvent en avant du matériel « héroïque », la réalité pour la plupart des utilisateurs tourne autour de l’équilibre vitesse/qualité/ressources GPU accessibles. Les pipelines RTX Video HDR, et en particulier l’implémentation DVDFab, montrent la convergence entre innovation technique et utilisabilité.

Exploitation du parallélisme des Tensor Cores

Les Tensor Cores NVIDIA sont conçus pour les opérations matricielles rapides au cœur de l’inférence deep learning. Appliqués à la vidéo, chaque image — ou segment — peut être traitée en parallèle, avec des charges réparties entre les cœurs disponibles. Par rapport aux anciens workflows HDR basés CPU/CUDA, le débit est multiplié par 4–8 sur du matériel RTX entrée/milieu de gamme, et plus encore sur haut de gamme.

Benchmarks : RTX HDR vs CPU & IA héritée

Les benchmarks montrent que RTX HDR surpasse largement les outils traditionnels. Exemple : un transcodeur CPU atteint 4–8 fps en 4K, tandis qu’un pipeline RTX atteint 20+ fps, avec des ressources stables, permettant le traitement par lots et même le multitâche.

Intégration DVDFab, rationalisation du workflow & expérience utilisateur

La valeur d’une solution avancée d’amélioration vidéo IA repose non seulement sur la vitesse brute, mais aussi sur l’intégration du flux de travail et l’expérience utilisateur. DVDFab NVIDIA AI Enhancer — qui intègre RTX Video HDR dans ses modules Copy, Ripper et UHD Creator — privilégie l’automatisation et la préservation des formats.

Module Copy (BD vers UHD HDR)

Les utilisateurs peuvent sélectionner des Blu-ray SDR ou DVD pour un upscale direct. Le système détecte automatiquement les fichiers compatibles, scanne la structure de chapitres et préserve les menus. Cela réduit les erreurs et élimine le prétraitement manuel.

Module Ripper : HDR multi-format automatisé

Optimisé pour la conversion en un clic : MKV, MP4, HEVC HDR10. L’IA est déclenchée automatiquement pour les entrées SDR, avec profils préconfigurés (HDR metadata, résolution, audio multi-canaux).

UHD Creator

Permet de créer des disques UHD HDR10 à partir de contenu SDR restauré, en préservant chapitres et sous-titres.

Expérience utilisateur : automatisations & profils

Profils prédéfinis (BD→UHD, vidéos familiales SDR→streaming, DVD anciens→HDR) facilitent l’usage, tout en laissant des options avancées disponibles.

Conclusion

RTX Video HDR exploite la technologie IA des GPU pour convertir du contenu SDR en HDR10 conforme, établissant un nouveau standard dans l’amélioration vidéo. DVDFab NVIDIA AI Enhancer illustre cette application pratique, intégrant traitement automatisé, préservation des formats et optimisation système. Pour les utilisateurs, cela signifie une qualité vidéo améliorée sans barrières techniques et une nouvelle valeur ajoutée aux bibliothèques physiques existantes. Cette technologie marque un tournant majeur dans le traitement de contenu vidéo, avec des impacts durables au niveau technologique, opérationnel et écosystémique.

Cet article vous a-t-il été utile ?

Participez à la discussion et exprimez-vous ici